La inteligencia artificial (IA) está transformando nuestro mundo a pasos agigantados. Desde los asistentes virtuales que nos ayudan en nuestras tareas diarias hasta los coches autónomos que prometen revolucionar el transporte, la IA está presente en cada vez más aspectos de nuestras vidas.

Sin embargo, este rápido avance también ha generado preocupación sobre los posibles riesgos de la IA. ¿Cómo podemos garantizar que la IA se desarrolle y utilice de manera responsable y ética? La respuesta está en los principios de la IA fiable.

¿Qué es la IA fiable?

La IA fiable es aquella que se diseña, desarrolla y utiliza de manera que respete los derechos humanos, los valores éticos y la autonomía humana. En otras palabras, la IA fiable debe ser beneficiosa para la sociedad y no debe causar ningún daño.

¿Cuáles son los principios de la IA fiable?

Existen diferentes marcos para definir los principios de la IA fiable. Uno de los más completos es el elaborado por la Comisión Europea en sus Directrices éticas para una IA fiable. Estos principios se pueden agrupar en tres categorías:

1. Licitud

- La IA debe cumplir con todas las leyes y regulaciones aplicables.

- La IA no debe utilizarse para fines ilícitos o engañosos.

2. Ética

- La IA debe desarrollarse y utilizarse de manera que respete los derechos humanos, los valores éticos y la autonomía humana.

- La IA no debe discriminar a las personas por ningún motivo.

- La IA debe ser transparente y explicable.

3. Robustez

- La IA debe ser segura y fiable.

- La IA debe ser resistente a los ataques y manipulaciones.

- La IA debe estar sujeta a controles humanos adecuados.

¿Cómo podemos garantizar la IA fiable?

Para garantizar que la IA se desarrolle y utilice de manera fiable, es necesario un esfuerzo conjunto por parte de todos los actores implicados:

- Gobiernos: Deben establecer marcos legales y regulatorios claros para la IA.

- Empresas: Deben desarrollar e implementar sistemas de IA que sean éticos y responsables.

- Investigadores: Deben desarrollar nuevas tecnologías de IA que sean seguras y fiables.

- Ciudadanos: Deben ser conscientes de los riesgos y beneficios de la IA y exigir que se utilice de manera responsable.

Ley Europea de IA

Un paso importante para la regulación de la IA en la Unión Europea.

La Ley Europea de IA se perfila como un hito fundamental en el camino hacia un futuro de IA responsable y ético. Esta ley, que entrará en vigor en 2025, establecerá un marco legal para el desarrollo y uso de la IA en la Unión Europea, con el objetivo de garantizar que la IA se utilice de manera segura, transparente y justa.

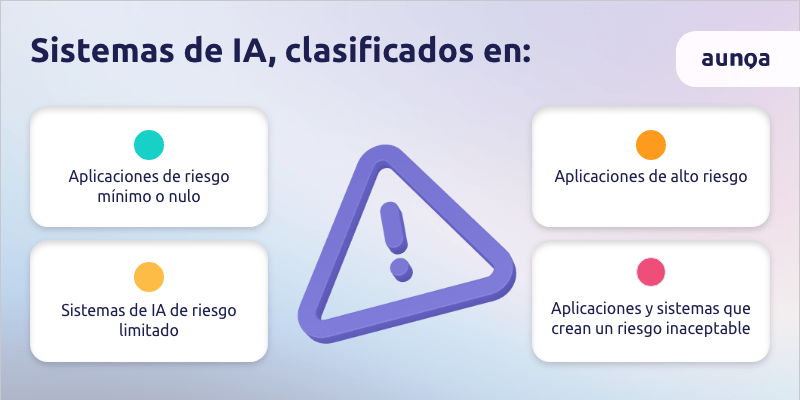

La Ley se basa en los principios de la IA fiable establecidos por la Comisión Europea en sus Directrices éticas para una IA fiable. Estos principios se traducen en una serie de requisitos específicos para los sistemas de IA, que se clasificarán en cuatro categorías de riesgo:

- Mínima: Sistemas de IA que presentan un riesgo bajo para la seguridad, la salud o los derechos fundamentales de las personas.

- Baja: Sistemas de IA que presentan un riesgo limitado para la seguridad, la salud o los derechos fundamentales de las personas.

- Alta: Sistemas de IA que presentan un riesgo elevado para la seguridad, la salud o los derechos fundamentales de las personas.

- Inaceptable: Sistemas de IA que presentan un riesgo inaceptable para la seguridad, la salud o los derechos fundamentales de las personas.

Los sistemas de IA que se clasifiquen en las categorías de riesgo “alta” o “inaceptable” estarán sujetos a requisitos más estrictos, como la necesidad de una evaluación de conformidad por parte de un organismo independiente.

Para profundizar en la Ley Europea de IA, te invitamos a consultar el artículo de uno de nuestros cofundadores, Fernando Pérez: “Cómo nos afecta la nueva Ley Europea de IA”

Ejemplos de IA fiable en la práctica

Existen muchos ejemplos de cómo se está aplicando la IA de manera fiable en la práctica. Algunos de ellos son:

- IA para la salud: La IA se está utilizando para desarrollar nuevos medicamentos, diagnosticar enfermedades y mejorar la atención al paciente.

- IA para la educación: La IA se está utilizando para personalizar el aprendizaje, proporcionar tutoría individualizada y evaluar el progreso de los estudiantes.

- IA para el medio ambiente: La IA se está utilizando para combatir el cambio climático, proteger la biodiversidad y gestionar los recursos naturales de manera sostenible.

¿Un futuro esperanzador o una distopía tecnológica?

El futuro de la IA depende de nosotros. Si nos comprometemos a desarrollar y utilizar la IA de manera fiable, podemos crear un futuro en el que la IA sea una fuerza para el bien en el mundo.

La pregunta es, ¿qué tipo de futuro queremos?

Te invitamos a unirte a nosotros en la construcción de un futuro de IA fiable. Puedes hacerlo:

- Informándote sobre los principios de la IA fiable.

- Exigiendo a los gobiernos y empresas que desarrollen e implementen sistemas de IA éticos y responsables.

- Apoyando a las organizaciones que trabajan para promover la IA fiable.

Juntos, podemos crear un futuro en el que la IA beneficie a toda la humanidad.